3、讲述了Spark SQL的Scala编程,主要包括:RDD与DataFrame相互转换、RDD与DataSet相互转换、DataFrame与DataSet相互转换 4、主要讲述了Spark SQL使用Scala自定义UDF函数和UDAF函数 注意:Spark SQL是没有UDTF函数的...

”spark scala“ 的搜索结果

现在Apache Spark已经形成一个丰富的生态圈,包括官方和第三方开发的组件或工具。Spark生态圈也称为伯克利数据分析栈,由AMPLab打造,是致力于在算法,机器,人之间通过大规模集成展现大数据应用的平台。1.Spark ...

SparkScala

标签: Scala

SparkScala

在Spark基础-实验列表下,单击Spark基础课程实验一:Spark简介右侧的【开始实验】按钮,具体如下图红色圈出部分:自动登录到私有云集群操作环境下,具体如下图所示:提升执行性能Spark SQL在Spark2.0 可以执行所有99...

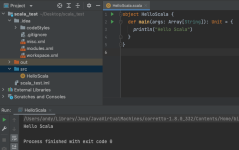

初步介绍scala,下载安装配置spark和scala,运行spark scala版本实例

在常见的用例中,通过几个基本脚本介绍了Scala programming language和Spark Scala 。 请检查以获取更多信息。 Scala项目 我的Coursera Scala系列课程的注释/代码 将Hadoop生态系统作业提交到AWS EMR的演示 各种...

最近有个spark集群压测时小任务,因为习惯了用maven,所以打算用maven的scala依赖来写spark程序。很久没写scala代码有些生疏,代码写好了,打包一直运行不起来,网上搜了很多材料发现没用,有的用ide打包,体验...

大数据编程Cause of death_使用spark scala编程完成的实验源码+数据集.7z

运行 MNIST 数据集的 ANN 的 Spark 实现。 人工神经网络 使用的 ANN 是bgreeven在 Spark 中的 ANN 实现。 它尚未合并到 Spark-MLlib 中,但现在。 汇编 要将项目编译为.jar文件,请使用 。 build.sbt文件包含 Spark...

火花测试 测试项目。 Spark + Intellij Idea + Scala的集成。

sparkscala开发依赖包 ECLIPSE 开发IDE需要的对应依赖包

本文章主要通过spark实现udf自定义函数import org.apache.spark.SparkConf import org.apache.spark.SparkContext import org.apache.spark.sql.SQLContext import org.apache.spark.sql.Row import org.apache....

大数据编程Cause of death_使用spark scala编程完成的实验源码

隔离林:隔离林无监督异常值检测算法的SparkScala实现

使用IDEA开发spark scala程序,配置idea开发工具,使用hadoop进行文件搜索

/*reduceByKey(function) reduceByKey就是对元素为KV对的RDD中Key相同的元素的Value进行function的reduce操作(如前所述),因此,Key相同的多个元素的值被reduce为一个值,然后与原RDD中的Key组成一个新的KV对。...

主要介绍了Jupyter notebook运行Spark+Scala教程,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

该资源可以简单计算文本中单词个数

请参见《Scala中Method方法和Function函数的区别》 作为函数的参数 一个匿名的函数传递给一个方法或者函数的时候,scala会尽量推断出参数类型。例如一个完整的匿名函数作为参数可以写为 scala> def ...

Val 和Var 的区别 一、最直观的就是:val定义的变量...scala> val s=10 s: Int = 10 scala> s=11 <console>:27: error: reassignment to val s=11 ^ scala> var a=10 a: In...

1. 在Scala声明private变量时,Scala编译器会自动生成get,set,在Scala中变量是需要初始化的,如果不声明private默认是public的 2. scala 中没有 static 关键字,在scala中没有静态方法和静态字段,所以在scala中...

本文主要通过使用spark的distinct进行去重,实现简单的UV统计import org.apache.spark.SparkConf import org.apache.spark.SparkContext import org.apache.spark.sql.SQLContext import org.apache.spark.sql.Row ...

一、避免null的使用 大多数语言都有一个特殊的关键字或者对象来表示一个对象引用的是“无”,在Java,它是null。在Java 里,null 是一个...二、Scala的Option的类型 Option是针对Map等集合操作的为了让所有东西都...

import org.apache.spark.SparkConf import org.apache.spark.sql.SparkSession import org.apache.spark.sql.functions._ object Dataframe_demo_01 { case class student11(name: String, course: String, score...

Spark scala 一行转多行 原始数据↓ A a1,a2,a3 B a4,a5 C a3,a5 D a1,a2,a3,a4 E a1 逻辑代码↓ val data = source .map(s => { val tmp1 = arr(0) val tmp2 = arr(1).split(",") (tmp1, tmp2) }) .map(s...

val sumValue = theDF.map(_(0).asInstanceOf[Double]).reduce(_+_)

spark scala读取文件选取特定列 wordcount.txt: a,1 c,2 a,1 选取最后一列 //选取特定列. val data=sc.textFile("file:///E://table//wordcount.txt") .flatMap(_.split("\n")) //按换行符分割文件,把文件分成一行...

推荐文章

- c语言链表查找成绩不及格,【查找链表面试题】面试问题:C语言学生成绩… - 看准网...-程序员宅基地

- 计算机网络:20 网络应用需求_应用对网络需求-程序员宅基地

- BEVFusion论文解读-程序员宅基地

- multisim怎么设置晶体管rbe_山东大学 模电实验 实验一:单极放大器 - 图文 --程序员宅基地

- 华为OD机试真题-灰度图恢复-2023年OD统一考试(C卷)-程序员宅基地

- 【机器学习】(周志华--西瓜书) 真正例率(TPR)、假正例率(FPR)与查准率(P)、查全率(R)_真正例率和假正例率,查准率,查全率,概念,区别,联系-程序员宅基地

- Python Django 版本对应表以及Mysql对应版本_django版本和mysql对应关系-程序员宅基地

- Maven的pom.xml文件结构之基本配置packaging和多模块聚合结构_pom <packaging>-程序员宅基地

- Composer 原理(二) -- 小丑_composer repositories-程序员宅基地

- W5500+F4官网TCPClient代码出现IP读取有问题,乱码问题_w5500 ping 网络助手 乱码 send(sock_tcps,tcp_server_buff,-程序员宅基地